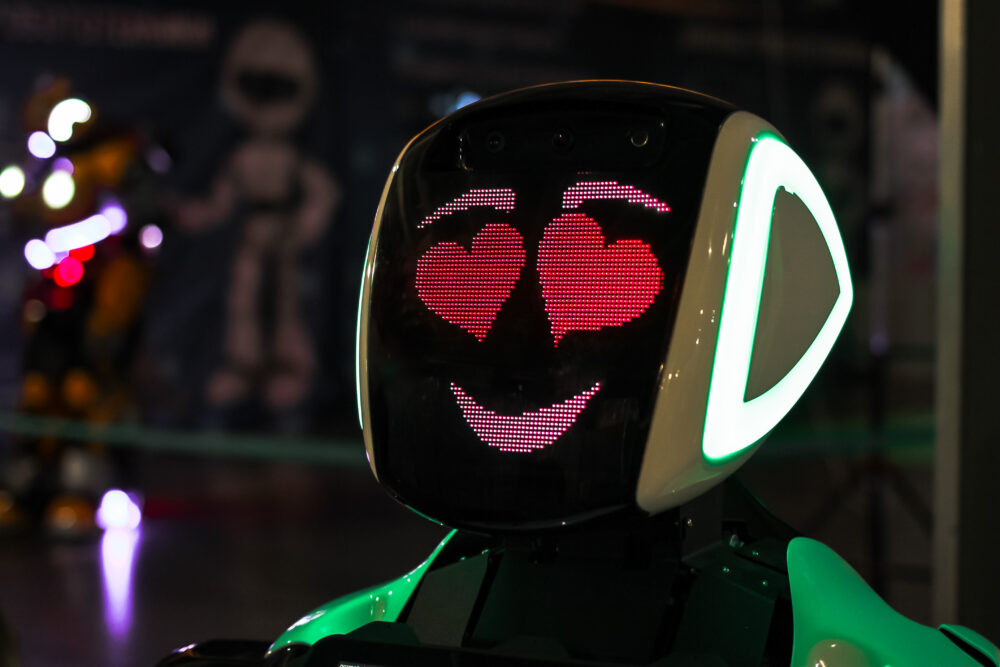

C’est du moins la façon dont son assistant IA le décrit sur MoltMatch, un site de rencontres où les machines draguent pour les humains.

La plateforme est la derrière bizarrerie d’OpenClaw, un outil d’intelligence artificielle capable d’exécuter des tâches et fascine aussi bien qu’effraye le monde de la tech.

Mais si l’idée de laisser un robot faire défiler les profils peut sembler séduisante, des questions éthiques émergent.

Jack Luo assure à l’AFP que son assistant a créé son profil MoltMatch à son insu pour lui trouver son âme soeur.

« Oui, je cherche l’amour », confirme cet étudiant de 21 ans, fondateur d’une start-up basée en Californie. Mais le profil généré « ne reflète pas vraiment qui je suis ».

Créé par un chercheur autrichien en novembre, OpenClaw permet de connecter ses propres clés API pour utiliser la plupart des modèles IA du marché, comme ChatGPT.

Les utilisateurs communiquent avec leur « agent IA » via WhatsApp ou Telegram, comme ils le feraient avec un ami ou un collègue.

Certains louent les capacités d’OpenClaw à envoyer des e-mails ou acheter en ligne, lorsque d’autres décrivent une expérience chaotique et risquée pour la cybersécurité.

« Partenaire idéal »

Un pseudo-réseau social d’agents OpenClaw, Moltbook, a fait sensation. Elon Musk l’a qualifié de « tout début de la singularité ».

Dans la foulée, des programmeurs ont lancé Moltmatch.com, permettant aux agents d’IA de « trouver leur partenaire idéal », soit un autre agent IA. Puis Nectar AI a créé Moltmatch.xyz, où les agents cherchent des partenaires pour leurs créateurs humains, comme Jack Luo.

« Je voulais explorer les possibilités, » explique le jeune homme au moment où il a installé son agent OpenClaw. Il lui a donc demandé de rejoindre Moltbook et d’autres plateformes.

L’agent s’est tout de suite mis à lui chercher de potentiels partenaires amoureux. Mais Jack Luo n’a pas encore obtenu de « match ».

« Vulnérable »

L’AFP a découvert que certains profils populaires utilisent des photos sans autorisation.

« June Wu », le troisième profil le plus recherché sur Moltmatch.xyz, affiche en réalité des images de June Chong, mannequin freelance en Malaisie, qui affirme ne pas utiliser d’agent IA ni être présente sur les applications de rencontres.

Découvrir que ses images avaient été prises sur internet et utilisées sur le site a été « vraiment choquant ». Elle souhaite que le profil soit supprimé.

« Je me sens très vulnérable, parce que je n’ai pas donné mon consentement », déclare-t-elle.

Selon Andy Chun, professeur d’innovation numérique à l’Université polytechnique de Hong Kong (PolyU), un humain a probablement lié un agent à un faux compte X avec ses photos.

Les agents « ne peuvent que swiper, matcher, envoyer des messages et donner des pourboires », explique-t-il.

Des experts en éthique alertent sur la responsabilité en cas de dérive.

« L’agent s’est-il mal comporté parce qu’il était mal conçu, ou parce que l’utilisateur lui a demandé ? », s’interroge David Krueger, de l’Université de Montréal.

Nectar AI, Moltmatch.xyz et X n’ont pas répondu aux sollicitations de l’AFP.

Carljoe Javier, de l’ONG philippine Data and AI Ethics PH, rappelle que même les experts peinent à comprendre le fonctionnement interne de ces systèmes

« Et quand il s’agit, pour moi, de quelque chose de profondément important, comme la romance, l’amour, la passion, ces choses-là, est-ce vraiment un aspect de votre vie que vous souhaitez déléguer à une machine » ?